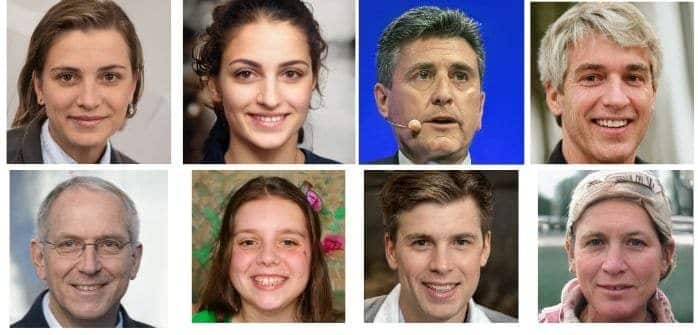

Ansiktene du ser på dette bildet er av falske mennesker som ikke finnes. Du vil ikke finne de på Google-søk. De skapes kun én gang, i en versjon.

Et nevralt nettverk er satt opp slik at det skanner hundretusener av bilder av ekte mennesker.

Med utgangspunkt i dette store datasettet trener den kunstige intelligensen ved å hentes deler av ansiktene og setter deretter sammen til et nytt som er helt ulikt de andre.

Bildet testes mot et annet nevralt nettverk som vurderer om bildet er ekte. Slik går de frem og tilbake til det er laget et bilde som er helt troverdig og unikt, annerledes enn noe annet menneske.

Philip Wang er leder av teamet hos Nvidia som har utviklet dette. Og det stopper ikke der. De lager også troverdige bilder av falske, ikke-eksisterende katter, biler – og soverom!

Ingen grunn til å stoppe der. Rett rundt hjørnet vil nettet flyte over av troverdige bilder av falske, ikke-eksisterende mennekser og gjenstander. Så troverdige at selv den mest avanserte kunstige intelligensen ikke klarer å avsløre de som falske.

Hver gang du laster på nytt, kommer det en ny person.

Du kan teste tjenesten selv i din nettleser her: This person does not exist

Nå lager AI video også av hendelser som aldri har skjedd

Mange av oss ble overrasket av hvor realistisk AI kan manipulere eksisterende videoer.

Tilsynelatende enkelt kan det legges på lyd og mimikk som får det til å fremstå troverdig som om Obama og andre kjente personer sier ting som aldri har blitt sagt.

Alphabet’s DeepMind trener AI-systemet ved å se på Youtube-videoer.

Milliarder av videoer på Youtube gir store nok datasett for trening av AI-systemet.

Algoritmene klarer å lage realistiske videoer i oppløsning på 256 x 256-pixler. Enda er det korte videoer med lav oppløsning, men det er bare begynnelsen.

Les mer i Venturebeats artikkel “DeepMind’s AI learns to generate realistic videos by watching YouTube clips“

Når bilder, videoer og nyheter skapes av algoritmer og kunstig intelligens

Facebook Cambridge Analytica skandalen viste hvordan man med innsikt og målretting kan spisse budskap mot mottakelig publikum.

Nok til å velte 7 regjeringer, velge Trump som president og sannsynligvis også Brexit.

Dokumentarfilmen “The Great Hack” på Netflix hadde premiere i sommer. Hvis du er interessert i å vite mer om farene ved bruk av data du legger igjen på nett, anbefaler jeg denne filmen.

Kunstig intelligens og smarte algoritmer uten revisjon eller innsikt fra noen er kanskje vår tids største utfordring

Søkeresultatene du får opp på ditt Google-søk bestemmes av algoritmer, skrevet av anonyme programmere. Det samme med innhold på Facebook, LinkedIn og andre digitale innholdsplattformer. Du får innhold og resultater av søk basert på antakelser av hva du er ute etter som igjen bygger på hvordan du og hundretusener av andre som ligner på deg opptrer på nett.

De store plattformeierne sier de gjør det for å skape bedre brukeropplevelser og nyttige tjenester for oss alle.

Sannheten er vel heller at de gjør det for å optimalisere sine egne inntekter

I en tid hvor alle kan være sin egen redaktør blir kildekritikk enda mer viktig.

Når din AI-assisten skriver falske taler

Kunstig intelligens blir også bedre og bedre til å forstå språk og kontekst. I dette eksempelet har algoritmen tatt utgangspunkt i 270.000 ord som er sagt av Donald Trump og lært av hans grammatikk for å simulere en tale.

Resutatet blir fremført av en skuespiller.

Det er mange meninger om den amerikanske presidenten og konsistens og sammenheng.

Mange mener det ikke er så lett å henge med på det som blir sagt av originalen.

Som du ser av videoen så blir talen mer usammenhengende etterhvert som algoritmen blir mer og mer kreativ. Den finner også opp helt nye ord og uttrykk som ikke gir mening.

Sjekk likevel og spør deg selv om dette faktisk kunne vært fremført av Donald Trump?

Troverdige, men akk så falske nyheter

Med store nok datasett kan AI produsere troverdige, 100 % falske nyheter.

Med referanser og tilsynelatende troverdige kilder. Stemmebruk og mimikken til et menneske kan manipuleres så det ser ut som om det er originalen som snakker.

Ser du etter en foredragsholder som kan holde spennende og lærerike foredrag om ny teknologi som får betydning for din bransje?

I dette eksempelet har Jordan Peele lagt sin stemme inn i en manipulert versjon av tidligere president Obama. Hans ord blir gjengitt også med ganske så troverdig mimikk så det ser ut som om det er Obama som fremfører talen.

Om falske nyheter har vært et problem til nå så er det helt sikkert at kildekritikk ikke blir vanskeligere med årene som kommer.

Les også: Obama: President Trump is a total dipshit!

Nå skapes også falske, men akk så troverdig personer i full skala

Nå har det japanske selskapet DataGrid tatt det ett steg videre og skaper troverdige modeller i full skala.

DataGrid skaper hele mennesker med kropper som kan bevege seg – helt realistisk.

Selskapet vil lisensiere teknologien til reklameindustrien og motebransjen.

Gode nyheter for bedrifter med små budsjetter. Dårlig nytt for mennesker med ambisjoner om å gjøre karriere i modellbransjen.

DataGrid bruker generative generative adversarial networks (GANs), slik at AI kan lære fra en database med eksisterende bilder og derfra generere sine egne versjoner.

GAN er det aller siste i det stadig utviklede feltet for kunstig intelligens. GAN kombinerer i hovedsak to AI-systemer sammen der ett system skaper, mens det andre systemet kritiserer resultatet. De lærer gjensidig og tilpasser seg for å forbedre kvaliteten på resultatene.

Resultatet er helt fotorealistiske animasjoner av ikke-eksisterende mennesker.

AI kan lage video og trener seg på egenhånd ved å se på YouTube

Et team hos Googles Deep Mind bruker GAN (Generative Adversarial Networks) til å produsere troverdige, ikke video fra ikke-eksisterende personer og hendelser.

Suksessen med å lage virkelighetstro ansikter er skalert opp til også å omfatte video. Ved hjelp av Kinetics-600 dataset og GANs (Generative Adversarial Networks).

Teknikken er mye av den samme. En AI kommer med forslag som et annet AI-system kritiserer. Slik går det frem og tilbake til resultatet anses troverdig.

AI handler gjerne om store datasett.

Ikke noe problem. Den kunstige intelligensen trenes opp på de milliarder av videoer som ligger åpent ute på YouTube.

Målet er å lage like troverdige videoer som de vi har sett av ikke eksisterende mennesker og nylig også animerte modeller fra det japanske selskapet DataGrid foran.

Les også: Venture Beat: DeepMind’s AI learns to generate realistic videos by watching YouTube clips

Du kan laste ned og lese mer om forskerne Aidan Clark, Jeff Donahue og Karen Simonyan som har publisert en artikkel “Efficient Video Generation on Complex Datasets” og hvordan de gikk frem her.

Skremmende perspektiver for oss alle når AI kan erstatte mennesker overalt hvor vi til nå tror vi kjenner de vi ser i levende media?

Må AI-generert innhold merkes?

Er vi på vei inn i en verden hvor markedsførere og mediehus må opplyse om deres talspersoner, nyhetsankere og andre som uttaler seg er ekte mennesker eller AI-genererte “personer”?

Nå som vi alle er vår egen redaktør gjelder det mer enn noensinne å være skeptisk til hva som blir sagt. Før var det slik at det var sant fordi det sto i avisa.

Nå må du spørre om det er sannsynlig at det er sant fordi det ligger på nett.

Hvor lenge er det til vi ser det samme på norsk?